ترانه علیدوستی| احسان علیخانی| هوش مصنوعی

از ترانه علیدوستی تا احسان علیخانی قربانی هوش مصنوعی شدند

انتشار عکس جعل شده احسان علیخانی در کنار مهلقا باقری و همچنین دستکاری تصاویر الناز شاکردوست بر تخت بیمارستان و گذاشتن چهره ترانه علیدوستی به جای او، آن هم درست در روزهایی که خبر بستری شدن این بازیگر در بیمارستان دست به دست میشد، آخرین نمونهها از استفاده زرد از هوش مصنوعی است.

ایران آرت: اگر شما هم این روزها تصاویر و آهنگهایی را میبینید و میشنوید که مطمئن نیستید واقعی هستند یا خیر، باید بدانید تنها نیستید چون یک نفر تصمیم گرفته نهایت استفاده از یک تکنولوژی پیشرفته را به بهانه سرگرمی تا این حد پایین بیاورد؛ یک سرگرمی گذرا که گاهی اثبات واقعی نبودنِ آن نیاز به قَسم و آیه دارد!

به گزارش ایسنا، هوش مصنوعی که با عنوان مخفف AI شناخته میشود، یک روش برای ساخت ابزارهایی هوشمند با الگوبرداری از هوش انسان است. در واقع هوش مصنوعی ابزاری است که شبیه انسان فکر میکند و در سادهترین حالت به آسانشدن کارهای او کمک میکند، هرچند این همه آن چیزی نیست که هوش مصنوعی به ما میدهد؛ بنابراین نمیتوان منکر شد که در کنار تمام مزایا، احتمالا معایبی هم دارد. معایبی که گاهی به دلیل ساختارهای فرهنگی میتواند آسیبهایی به همراه داشته باشد.

این تکنولوژی که بیش از نیم قرن است به جزئی جداییناپذیر از زندگی انسان تبدیل شده، شاخهای گسترده از علوم کامپیوتر است که البته همیشه در قالب فیزیکی دیده نمیشود، موضوعی که نمودی از آن را در چت جیپیتی (Chat GPT) میبینیم. با این وجود کاربردهای هوش مصنوعی بسیار متفاوت و گسترده است و این روزها در بخش مهمی از زندگی ما نقش دارد. از همان لحظهای که تصمیم میگیریم درباره موضوعی در گوگل سرچ کنیم تا آن زمان که به دستیار صوتی تلفن همراهمان دستور میدهیم یک موسیقی پِلی کند، در حال کار با هوش مصنوعی هستیم.

البته خدمات هوش مصنوعی تنها منحصر به این موارد نیست؛ تشخیص بیماریهای مهمی از جمله نارسایی قلبی، ساخت دستیار جراح هوش مصنوعی، هشدار زودهنگام بروز سیل، استفاده از چت پات روانشناس، پیشبینی هواشناسی، مقابله با تغییرات اقلیمی و... تنها بخشی از کارهایی است که میتوان با هوش مصنوعی انجام داد؛ البته مانند هر تکنولوژی دیگری، در این بخش هم عدهای به دنبال استفادههای سطحیتر از آن هستند.

موضوعی که طی تقریبا دو سال گذشته باعث شده تا شناخت افراد از هوش مصنوعی افزایش پیدا کند، آغاز به کار و گسترش چت جیپیتی است. حل مسائل برنامهنویسی، ترجمه و ویرایش متون، پاسخ به برخی سوالات، ساخت و ادیت عکس و... از جمله کارهایی است که میتوان با چت جیپیتی انجام داد. با این وجود، اما به نظر میرسد بخشی خاص از این تکنولوژی جذابیت بیشتری پیدا کرده است. بله، بخش زردِ ماجرا!

میدانیم که جذابیت موضوعاتِ زرد محدود به مرزهای جغرافیایی نیست؛ در واقع نمیتوان آرمانشهری را تصور کرد که هوش مصنوعی در آن تنها برای مصارف علمی، تحقیقاتی، سهولت در کارها و ... استفاده شود و افرادی پیدا نشوند که صدا یا تصویری جعلی با این تکنولوژی بسازند. با این وجود ما در این گزارش به آن بخشی از هوش مصنوعی میپردازیم که اسباب سرگرمی ایرانیان را فراهم کرده است.

برای برخی افراد، گمراه کردن دیگران یک سرگرمی به حساب میآید و در این شرایط چه ابزاری بهتر از هوش مصنوعی؟ این تکنولوژی قابلیتی را به این افراد میدهد تا تصاویر، فیلمها و صداهایی جعلی بسازند که دیگران نتوانند درست یا غلط بودن آنها را به راحتی تشخیص دهند. کاری که البته گاهی ابعاد آن از یک سرگرمی فراتر رفته و میتواند چالشزا باشد، چالشهایی که باعث شکلگیری اصطلاح «جعل عمیق» در دسته اخبار جعلی یا Fake Newsها شده است.

در «جعل عمیق» با استفاده از تصویر یا صدای افراد، نسخهای جعلی میسازند و صدایی را تولید میکنند که هرگز آن فرد به زبان نیاورده و یا ویدیو و عکسی از او میسازند که فرد هرگز در آن حضور نداشته است. به طور کلی تولید محتوای جعلی برای افراد مشکل آفرین است، اما صوت و تصویر، بیش از متون نوشتاری دست به دست میشود و حتی کسانی که حوصله خواندن متنها را ندارند، به راحتی زمانی را به دیدن و شنیدن سایر محتواهای جعلی اختصاص میدهند و این محتوا ماندگاری بیشتری هم در اذهان عمومی دارند.

نمودِ بیشتر این اتفاق را در آنچه که در مورد بازیگران، خوانندگان و افراد مشهور اتفاق میافتد، شاهد هستیم. در واقع گاهی محتوای جعلی تولید شده توسط هوش مصنوعی آنچنان به واقعیت نزدیک است که حتی رسانهها هم توانایی تشخیص آن را ندارند و به یکباره خبری جعلی به تیتر یکِ رسانهها تبدیل میشود. در چنین شرایطی فرد مشهور باید با هر ابزاری که در دست دارد، صدایش را به دیگران برساند که محتوای تولید شده مربوط به او نیست.

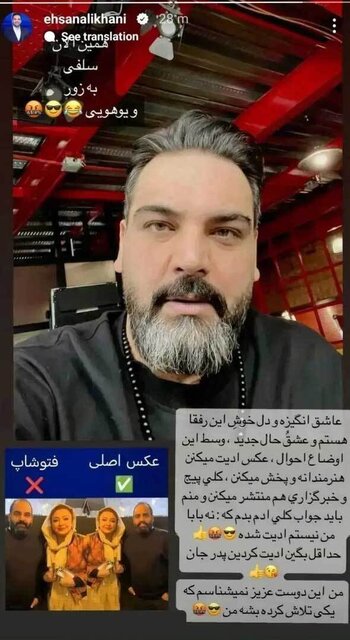

انتشار عکس جعل شده احسان علیخانی در کنار مهلقا باقری و همچنین دستکاری تصاویر الناز شاکردوست بر تخت بیمارستان و گذاشتن چهره ترانه علیدوستی به جای او، آن هم درست در روزهایی که خبر بستری شدن این بازیگر در بیمارستان دست به دست میشد، آخرین نمونهها از استفاده زرد از هوش مصنوعی است. موضوعی که احسان علیخانی را وادار کرد تا با انتشار یک استوری در صفحه اینستاگرام خود نسبت به آن واکنش نشان دهد و بنویسد: «عاشق انگیزه و دلِ خوش این رفقا هستم و عشقُ حال جدید، وسط این اوضاع احوال، عکس ادیت میکنن، عکس اصلی و هنرمندانه فتوشاپ و پخش میکنن، کلی پیج و خبرگزاری هم منتشر میکنن و منم باید جواب کلی آدم بدم که: نه بابا من نیستم ادیت شدهام. حداقل بگین ادیت کردین پدر جان. من این دوست عزیز نمیشناسم که یکی تلاش کرده بشه من».

تصویر سمت چپ جعلی

گاهی هم افراد برای سرگرم شدن با هوش مصنوعی، پا را فراتر گذاشته و کاری میکنند تا برخی خوانندگانِ فوت شده، لقب از گور بازگشته را بگیرند تا دیگر انحصار انتشار قطعات موسیقیِ پس از مرگ، از دست مرتضی پاشایی خارج شده و به دست افراد دیگری برسد! چنانچه نمونهای از این کار را در بازخوانی یکی از قطعات شادمهر عقیلی توسط هوش مصنوعی با صدای یک خواننده زن فوت شده شاهد بودیم؛ قطعهای که تا مدتها فضای اینستاگرام را تسخیر کرد و کمتر خودرویی در سطح شهر پیدا میشد که صدای این آهنگ از آن بیرون نیاید.

البته همیشه هم قرار نیست سوء استفاده از پیشرفت تکنولوژی برای سرگرم شدن باشد. در شرایطی که ساخت محتوای جعلی روزبهروز پیشرفتهتر میشود، این بستر گاهی به ابزاری برای تخریب و تهدیدِ یک فرصت تبدیل میشود. به عنوان مثال تهیه مدارک و تصاویر جعلی، ایجاد اطلاعات غلط برای تخریب افراد سرشناس، دستکاری اسناد مالی و... از جمله مواردی است که گروههای رقیب ممکن است در قبال یکدیگر انجام دهند.

با این وجود شاید شما فکر کنید شناسایی یک محتوای جعلی کاری راحت است، اما باید بدانید گاهی محتوای جعل شده چنان به واقعیت نزدیک است که حتی اثبات اینکه فردِ در یک تصویر یا صوتِ منتسب به یک شخص، در واقعیت مربوط به او نیست به سختی امکان پذیر است و در شرایطی که قانونگذاری مشخصی هم در این زمینه وجود ندارد، ممکن است در مسیرِ اثبات رخ ندادن یک اتفاق، چالشهای جدی سر راه یک فرد قرار گیرد.

با این حال نمیتوان منکر شد که جعل عمیق در فیلمسازی، انیمیشنسازی، هنر و... کاربردهای مفیدی دارد و میتواند در زمان و هزینهها صرفهجویی کرده و غیرممکنها را ممکن کند! به عنوان مثال به مدد وجود هوش مصنوعی و جعل عمیق، فیلم زندگی ولادیمیر پوتین - رئیس جمهور روسیه ساخته شده و در حالی که هوش مصنوعی نقشِ یک آن است، به زودی اکران میشود.

بر این اساس در شرایطی که حتی میتوان با هوش مصنوعی شقالقمر کرد، بَند کردن به بخش سرگرم کننده آن که البته آن هم خالی از آفت نیست، منطقی به نظر نمیرسد. ما نوعی از تکنولوژی را دستِ کم گرفتهایم که قرار است کارهای بسیار بزرگتری از ادیتِ عکس بازیگران، صداگذاری خوانندگان و... انجام دهد؛ بنابراین بهتر است به جای آنکه به دنبال کشف جعلی یا اصلی بودن یک موضوعِ کم اهمیت باشیم، زودتر دست به کار شویم و هوش مصنوعی را جدی بگیریم.